人工智能学会根据签名生成图像并开始更好地了解我们的世界

在所有人工智能模型中,OpenAI的GPT-3最能吸引公众的想象力。她在没有多大提示的情况下就能散发出诗,短篇小说和歌曲,使您认为这些是一个人的工作。但是,口才只是a头,不应与真实的智力相混淆。

但是,研究人员认为,用于创建GPT-3的相同技术掩盖了创建更高级AI的秘密。GPT-3受过大量文本信息的培训。如果在文本和图像上同时训练了相同的技术怎么办?

保罗·艾伦人工智能研究所的一项名为AI2的新研究将这一想法推向了新的高度。研究人员创建了一种特殊的视觉语言模型。它可以处理文本和图像,并可以从签名生成图像和图像。这些图像看起来令人不安和陌生,完全不像生成对抗网络(GAN)所创建的超现实主义深度假货。但是它们可以显示出更多实用情报的新方向,并可能使机器人更智能。

填满空隙

GPT-3属于一组称为“变压器”的模型。由于Google算法BERT的成功,他们首先获得了欢迎。在BERT之前,语言模型非常糟糕。他们的预测能力足以自动完成,但不足以构成长句子,而语法和常识是可以观察到的。

BERT通过引入一种称为“遮罩”的新技术(请注意-原始名称是“遮罩”)来改变了情况。这意味着句子中隐藏着不同的单词,并且模型必须填补空白。例子:

- 女人去___练习。

- 他们买了___面包做三明治。

这个想法是,如果强迫模型执行这些练习(通常进行一百万次),它将开始检测单词如何组合为句子以及句子如何组合为段落的模式。结果,该算法可以更好地生成和解释文本,从而更加了解语言的含义。 (Google现在正在使用BERT来提供更多相关的搜索结果。)在证明掩盖非常有效之后,研究人员试图通过将签名中的单词隐藏起来将其应用于视觉语言模型。通过这种方式:

____在树旁的地上。来源:AI2

这次,模型可以查看周围的单词和图像内容以填补空白。经过一百万次重复,她学会了不仅检测单词的模式,而且还检测单词与每个图像元素的联系。

结果,模型可以将文本关系链接到婴儿如何在学到的单词和他们看到的事物之间建立联系的视觉示例。模特们可以在下面拍摄照片,并贴上有意义的标题,例如“女子运动曲棍球”。或者,他们可以通过将单词“ ball”与照片中的圆形物体相关联来回答诸如“球形是什么颜色”之类的问题。

视觉模型可以为这张照片加上一个有意义的标题:“妇女运动曲棍球”。资料来源:JOHN TORCASIO / UNSPLASH

最好一次看一张图片

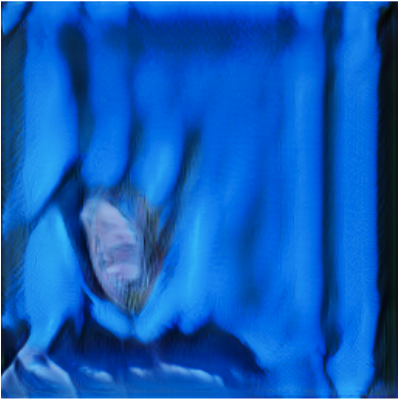

研究人员想知道这些模型是否发展了对视觉世界的概念性理解。即使对象本身不存在,已经为对象学习单词的孩子不仅可以为其命名,还可以根据提示绘制对象。因此,AI2项目团队建议模型做同样的事情:从字幕生成图像。所有模型都发出了毫无意义的像素垃圾。

它是一只鸟吗?这是飞机吗?不,这是由人工智能产生的胡言乱语。资料来源:AI2

这是有道理的:将文本转换为图像比执行相反操作更困难。 AI2的计算机视觉团队负责人Ani Kembhavi说:“签名并不能定义图片中的所有内容。”因此,该模型必须利用关于我们世界的大量知识来添加缺失的细节。

例如,如果要求模型绘制“沿着道路行走的长颈鹿”,则她需要得出结论,道路将是灰色的而不是亮粉色,并且将经过田野而不是大海。尽管所有这些信息都不明确。

因此,Kembhavi和他的同事Jemin Cho,Jiasen Lu和Hannane Hajishirzi决定看看他们是否可以通过调整遮罩方法来教授模型所有这些隐藏的视觉知识。他们没有训练算法来简单地预测相应照片的标题中的“被遮盖”的单词,而是还训练了算法以基于相应的标题来预测照片中的“被遮盖”的像素。

模型创建的最终图像并不完全真实。但这并不重要。它们包含正确的高级视觉概念。 AI就像孩子在画一个破折号来代表一个人一样。 (您可以在这里自己测试模型)。

AI2模型从字幕生成的样本图像。资料来源:AI2

视觉语言模型生成此类图像的能力代表了人工智能研究的重要一步。这表明该模型实际上具有一定程度的抽象能力,这是理解世界的基本技能。

从长远来看,该技能可能会对机器人技术产生重要影响。机器人对环境的了解越好,使用语言进行交流的能力就越强。 Hajishirzi指出,在短期内,可视化将帮助研究人员更好地了解该模型正在学习的内容,该模型现在就像黑盒子一样工作。

将来,该小组计划进行更多实验,提高图像生成的质量,并扩展模型的视觉和词汇:包括更多主题,对象和形容词。

陆说:“图像的创建确实是难题的缺失部分。” “通过添加它,我们可以教导模型更好地了解我们的世界。”